| HIFI-FORUM » Stereo » Elektronik » CD-/SACD-Player & andere digitale Quellen » Wie viel Sinn machen 32 Bit, 192 kHz und 384 kHz? | |

|

|

||||

Wie viel Sinn machen 32 Bit, 192 kHz und 384 kHz?+A -A |

||||

| Autor |

| |||

|

Goalkeeper1

Ist häufiger hier |

#1

erstellt: 27. Dez 2011, 01:01

|

|||

|

Hallo, die Bit-/kHz-Thematik interessiert mich jetzt immer mehr ... Eine normale, handelsübliche CD hat 16 Bit / 44,1 kHz Eine Audio-Blu-ray (HD-Audio) hat, soweit mir bekannt, 24 Bit / 96 kHz Nun frage ich euch: Kann mir einer verraten, was für ein Sinn - 24 Bit / 192 kHz oder sogar - 32 Bit / 384 kHz machen???? Audio-Titel mit 24/192 werden mittlerweile im Internet angeboten, aber ich weiß nicht warum? Einen Unterschied zw. 24/96 und 24/192 höre, ich zumindest, nicht raus. Den einzigen Unterschied sehe ich beim Preis. Ich habe mich schon schwer getan beim Vergleich 16/44,1 und 24/96 das qualitativ Bessere zu identifizieren. Und was ich am aller tollsten finde, ist, dass es sogar schon DA-Wandler mit 32 Bit / 384 kHz Ausgabe gibt. Kann mir vielleicht einer verraten, was das bringen soll? Ist für mich totaler Unfug!! |

||||

|

Das.Froeschle

Inventar |

#2

erstellt: 27. Dez 2011, 01:41

|

|||

Da bist Du nicht allein. CD-Qualitär reicht voll und ganz (wenn Sie denn vom Tonstudio ausgereizt würde...  ) ) |

||||

|

|

||||

|

Accuphase_Lover

Inventar |

#3

erstellt: 27. Dez 2011, 01:58

|

|||

Beidem darf ich mich hiermit anschließen !  |

||||

|

Goalkeeper1

Ist häufiger hier |

#4

erstellt: 27. Dez 2011, 02:47

|

|||

ok, dass mit HD-Audio (24/96) kann ich noch verstehen und man hört einen Unterschied raus. Bei mir hat es zwar gedauert, aber ich konnte ihn dann doch raushören. 24/192 oder das "exotische" 24/176 halte ich ich für Abzocke. Die größte Idiotie sehe ich aber in der Tatsache, dass es wirklich Firmen gibt, die eine 32/384 DA-Wandler auf den Markt bringen. |

||||

|

Lawyer

Inventar |

#5

erstellt: 27. Dez 2011, 02:57

|

|||

|

Ich für meinen Teil empfinde das nicht als Unfug. Wenn das Quellmaterial nicht gut ist, wird man zwischen 16 und 24bit keinen Unterschied hören, da gebe ich euch voll und ganz recht. Ein bekannter, der Tontechniker gelernt hatte und auch Musik macht, hat mir da vor ein paar Jahren was gezeigt. Und zwar hatte er seine Musik direkt in 32 Bit aufgenommen, wieviel kHz kann ich nicht mehr sagen, das ist zu lange her. Auf jeden Fall hat er davon mit Wavelab auch eine 16 und 24 Bit Version erstellt. Als erstes lief die 16 Bit, danach die mit 24 und am Ende mit 32Bit. Ich konnte da jedes mal einen deutlichen Sprung an Auflösung feststellen. Ich glaube, das wenn man gut erhaltene Masterbänder von früher in 32Bit neu abtasten würde, könnte man da noch einiges rausholen. Das eine CD im Prinzip reicht, würde sie denn voll ausgenutzt, kann man nicht leugnen. Nur welche sind das schon ? Ich hätte nichts dagegen, wenn es neben der normalen CD noch einen bezahlten Download in höherer Auflösung und mit besserem Klang gibt. Dafür würd ich auch ein paar Euros mehr ausgeben. Somit sehe ich an den Wandlern die mehr können keine Idiotie, sondern einfach den möglichen Stand der Technik. Gruß Christian |

||||

|

M4L0iK

Ist häufiger hier |

#6

erstellt: 27. Dez 2011, 04:14

|

|||

Da gebe ich Dir vollkommen recht, aber Du sagst ja selber "wenn die Quelle nicht gut ist, wird man zwishen 16 Bit und 24 Bit keinen Unterschied feststellen können". Und ich glaube, dass es allgemein bekannt ist, dass die CD nicht komplett ausgereizt wird. Aber dennoch stehe dieser HD-Audio-Geschichte lächelnd gegenüber. Heute verlangen alle (plötzlich) hochauflösendes Audiomaterial und sind bereit "auch ein paar Euro mehr zu zahlen". Vor Jahren wurden den Leuten SACD und DVD-A angeboten mit genau der Eigenschaft wie sie heute alle haben wollen: hochauflösende Musik.  Trotzdem wurde diese Medien verschmäht. Heute kriegt man das Ganze vollkommen steril: nichts Handfestes, kein Cover, kein Booklet, dafür ein eine Audiodatei, die man mit einem ordinären Mausklick bedient. Ich könnte kotzen ...  Aber zur Ausgangsfrage zurückzukommen: Ja und Nein. Sinn macht das Ganze nur die Quelle / das Master geeignet dafür ist. 32 Bit haben durchaus ihre Berechtigung, da, wie schon erwähnt, die Auflösung zunimmt. Über die Abtastrate kann ich nur Folgendes sagen: Ich höre zwischen 44,1 kHz, 96 kHz und 192 kHz Unterschiede heraus. Es mögen teilweise nur Nuancen sein, aber trotzdem sind Unterschiede vorhanden. 384 kHz haben ich bis heute noch nicht gehört. Aber ein Audiostück in 32 Bit / 384 kHz könnte ich mir als ein Sahnestück vorstellen.  [Beitrag von M4L0iK am 27. Dez 2011, 04:43 bearbeitet] |

||||

|

cr

Inventar |

#7

erstellt: 27. Dez 2011, 04:42

|

|||

|

32 Bit macht gar keinen Sinn. 24 Bit macht Sinn wegen der digitalen Bearbeitungsschritte und Rundungsfehler Für den Endverbraucher würden eigentlich 18 Bit die sinnvolle absolute Obergrenze sein, denn mehr als echte 18 Bit schaffen in Wahrheit auch die aufgemotztesten 24- oder 32-Bit-Wandler nicht. 18 Bit = 112 dB!

Glaube ich nicht, siehe oben. Mehr als echte 18 Bit kommen halt auch bei einem 32-Bit-Wandler nicht heraus. Aber ich lasse mich gerne eines Besseren belehren, wenn mir wer ein seriöses Wandlerdatenblatt volegt, wo steht: Quantisierungsrauschabstand > 112 dB Wer weiss, was dir da vorgespielt wurde. War sicher ungleich laut und auch sonst nicht vergleichbar. [Beitrag von cr am 27. Dez 2011, 04:46 bearbeitet] |

||||

|

Lawyer

Inventar |

#8

erstellt: 27. Dez 2011, 11:26

|

|||

|

SACD und DVD-A habe ich nie gehört, somit kann ich mir dazu kein Urteil erlauben. Deren Problem war wohl, das dort hauptsächlich Klassische Musik und das, was gern auf Messen läuft, veröffentlicht wurde. Der, ich nenns jetzt mal Mainstream, wurde eher links liegen gelassen bzw. gab es da zu wenig veröffentlichungen in dem Bereich. Man hätte was gebraucht wie damals "Brothers in Arms" von den Dire Straits, was ja die CD verkäufe gepusht hatte. Die Technik war und ist gut, aber leider waren ein paar Fehler hausgemacht. Hallo cr, die mir vorgespielte Musik war gleich laut, einen Unterschied bei direktem umschalten hätte man deutlich gehört, da über Kopfhörer gehört wurde. Das es sonst nicht vergleichbar war, glaube ich nicht. Was soll an einem Hochauflösenden Stück, welches mit professioneller Software wie Wavelab runtergerechnet wird, nicht vergleichbar sein ? Und: Auch die von dir angesprochenen 18 Bit werden besser sein als 16Bit, wenn die Quelle besser ist. Es gibt ja bereits einige Hochbit-Downloads, aber wenn sie nur hochgerechnet sind, halte ich nichts davon. Gruß Christian |

||||

|

pelmazo

Hat sich gelöscht |

#9

erstellt: 27. Dez 2011, 12:51

|

|||

|

M4L0iK

Ist häufiger hier |

#10

erstellt: 27. Dez 2011, 15:13

|

|||

|

Ich sag's mal so: 32 Bit / 384 kHz sind möglich aber nicht nötig, da man's nicht braucht. Für den Privatgebrauch sind 24 Bit / 192 kHz vollkommen ausreichend (sogar zu viel). Natürlich macht das auch optisch etwas her: 16/44,1 zu 24/192. Alleine schon die Beschreibung suggeriert einem ein besseres Hörerlebnis. Ich war von der SACD absolut überzeugt, jedoch habe Leute Fehler bereits in den eigenen Reihen gebaut, indem sie nur Klassik und Jazz auf SACD veröffentlicht haben. Mehr Mainstream (Pop, R&B, Rock) oder Metal hätten der SACD sehr gut getan. Es ist halt dumm, wenn man ein neues Medium herausbringt mit Material für ältere Semester, wo die Kaufkraft doch gerade bei der jungen Generation so hoch ist. Hätten sie von Anfang an so Sachen wie RIHANNA, BON JOVI, AC/DC, BEYONCÉ, METALLICA, MICHAEL JACKSON, etc. auf SACD herausgebracht, wäre die CD heute sicherlich im Ruhestand. |

||||

|

cr

Inventar |

#11

erstellt: 27. Dez 2011, 15:20

|

|||

Und die Konsequenz wäre, dass sich niemand die Musik auf Festplatte rippen könnte. |

||||

|

Das.Froeschle

Inventar |

#12

erstellt: 27. Dez 2011, 15:24

|

|||

Naja...  für Metallicas "Death Magnetic" hätten sogar für Metallicas "Death Magnetic" hätten sogar 4 1/2 Bits gereicht. 4 1/2 Bits gereicht.  Bitte unterscheide zwischen 'Mastering' im Studio, wo 24Bit/96kHz durchaus sinnvoll sind, und dem Distributionsformat wie z.B. einer CD. Da reichen 44,1 kHz mit 16 bit absolut. |

||||

|

M4L0iK

Ist häufiger hier |

#13

erstellt: 27. Dez 2011, 15:31

|

|||

Glaub' ich so nicht. Sicherlich wären mit der Zeit auch SACD-kompatible PC-Laufwerke erschienen, womit man die SACD 1:1 auf die Festplatte hätte rippen können. |

||||

|

cr

Inventar |

#14

erstellt: 27. Dez 2011, 15:34

|

|||

|

Vergiss es, diese Laufwerke wären nicht gekommen, solange das Sony-Patent gilt, also 20 Jahre ab Start. Warum meinst du, gab es nie ein Minidisk-Laufwerk? Der Bedarf daran war groß. |

||||

|

Burkie

Inventar |

#15

erstellt: 27. Dez 2011, 16:17

|

|||

|

Diese ganzen neuen Audio-Formate (SACD, HDCD, etc) sind völlig sinnlos, weil die Musik spätestens beim Mastern kaputt gemacht wird: Alles wird auf eine einheitliche hohe Lautheit gebracht, wobei die Klangqualität verloren geht. Es genügen dann in der Regel Auflösungen von ca. 6-8 Bit und Abtastfrequenzen von ca. 30kHz. CDs sind da noch deutlichst überdimensioniert. Da heutzutage das Ziel einer Studioproduktion ein kaputter totgemasterter Klang ist, lohnen sich hohe Auflösungen und Abtastraten auch im Studio eigentlich nicht, da das Ziel ja ein Sound schlechter als ein Kofferradio ist...  MfG |

||||

|

Hörbert

Inventar |

#16

erstellt: 27. Dez 2011, 16:24

|

|||

|

Hallo! Das ganze ist, -finde ich-, ohnehin ein Streit um des Kaisers Bart, der eigentliche Flaschenhals liegt schon bei einer normalen 16 Bit-Aufnahme bei den Mikrophonen und nicht bei der Codierung oder dem Headroom. Solange die Mikrophonteechnik nicht entscheidend verbessert werden kann, -was derzeit nicht in Sicht ist-, wird keine noch so hohe Auflösung ein echtes, -jederzeit nachvollziebares-, hörbares Ergebniss jenseits der CD erbringen. Aufnahmen mit höherer Bitrate sind deshalb m.E. nur für Mehrkanaltonträger Sinnvoll. Bei Stereroaufnahmen reicht die alte CD allemal aus. MFG Günther |

||||

|

Burkie

Inventar |

#17

erstellt: 27. Dez 2011, 17:27

|

|||

|

Es gibt schon digitale Mikrophone mit Dynamikumfang um 130dB, immerhin A-bewertet.  http://www.neumann.c...ophones&cid=d01_data http://www.neumann.c...ophones&cid=d01_dataDamit könnte man schon die Auflösung einer CD ausnutzen. Die Bitrate und die Auflösung hängen zwar zusammen, sind aber nicht das gleiche! Bitrate gibt an, wieviele Bits pro Zeit transportiert werden müssen. Auflösung sagt an, mit wievielen Bits ein Sample digitalisiert wird. Mehrkanal-Tonträger wären ganz interessant. Leider werden und wurden diese Formate von der Plattenindustrie kaputt gemacht. In Europa sollte es die SACD sein, für die man aber leider ein eigenes Abspielgerät benötigt. In USA die DVD-Audio, die in den speziellen DVD-Audio-Formaten auch ein eigenes Gerät benötigt. Was schon massig in den Haushalten war, waren aber Mehrkanal DVD-Videoabspieler. CDs oder DVDs, die damit kompatibel wären und garantiert mehrkanalig auf allen DVD-Spielern funktionierten (DTS-CDs, Dolby-Digital-DVDs, ...), wäre was interessantes gewesen selbst für Durchschnittskonsumenten. Aber eine Vermarktungspolitik, bei der man schon wieder ein neues Kästchen (SACD-Player) samt den ganzen Kabeln benötigt; bei der man sich nicht mal eben ratz-fatz eine Kopie für den MP3-Spieler oder das Autoradio machen kann; wo also nur Probleme für den Konsumenten generiert werden, konnte nicht gut gehen. MfG [Beitrag von Burkie am 27. Dez 2011, 17:28 bearbeitet] |

||||

|

cr

Inventar |

#18

erstellt: 27. Dez 2011, 18:45

|

|||

|

Das passiert, wenn man den Bogen überspannt. Jedem einen SACD-oder DVDA-Player um mindestens 1000 Euro aufzuschwatzen, das ist gründlich in die Hose gegangen  Wie du richtig sagst, hätte man klein aber fein die DVD als Mehrkanalmedium und hochauflösendes Stereomedium nützen können (96/24 !!), und das auf JEDEM DVD-Player abspielbar. |

||||

|

8bitRisc

Inventar |

#19

erstellt: 28. Dez 2011, 16:07

|

|||

|

Im Gegensatz zum Audiosektor setzen sich auf dem Videosektor neue Formate auch durch. Erst VHS, dann S-VHS, danach die DVD und seit einigen Jahren die Blue Ray-DVD. Der Grund liegt ganz einfach in der auch für Laien sichtbaren Verbesserung der Qualität. Bei Audio ist das anders; der Normalo hört hier keinen oder nur einen minimalen Unterschied. Ich bin mir sicher, daß es in einigen Jahren auf dem Videosektor noch höher auflösende Formate geben wird, welche sich dann wiederum ohne Probleme durchsetzen werden. Auf dem Audiosektor ist dann die CD aber immer noch der Standard. Interessant ist auch, daß die Vinylscheibe eine Nische erobert hat und noch lange am Leben bleiben wird. Der VHS-Videorekorder und der Röhrenfernseher werden in den nächsten Jahren wohl ganz verschwinden und nur noch im Museum zu bestaunen sein. Gruß Johannes |

||||

|

Hörbert

Inventar |

#20

erstellt: 28. Dez 2011, 17:23

|

|||

|

Hallo! Wahrscheinlich kommen hochauflösende Mehrkanal-Musikformate zukünftig ohnehin als Musik plus Bild quasi durch die Hintertür. Die Tage der reinen Audiowiedergabe dürften gezählt sein. MFG Günther |

||||

|

Jeck-G

Inventar |

#21

erstellt: 29. Dez 2011, 00:41

|

|||

|

||||

|

Burkie

Inventar |

#22

erstellt: 29. Dez 2011, 00:56

|

|||

|

Hallo, Mehrkanal-Formate finde ich auch ganz interessant. De Facto werden reine Musikaufnahmen leider immer noch bloß in Stereo produziert. Für den MP3-Download-Markt, deren Konsumenten wohl hauptsächlich per Kopfhörer am I-Pod abhören, als auch für den Radio-Einsatz dürfte das auch das Format der Wahl sein. Somit ist es logisch, dass die Produzenten vorrangig dieses Format bedienen, und die Abmischungen für Stereo machen. Video-DVDs, hauptsächlich wohl Konzert-Aufnahmen haben wohl meist auch einen 5.1-Surround-Sound-Ton. Für den Musik-Konsumenten haben DVDs einen gravierenden Nachteil: Der Ton lässt sich nicht einfach mit dem Windows-Media-Player als MP3 rippen, wie das bei CDs möglich ist, um sich ein MP3 für den I-Pod oder das Autoradio zu machen. Erst wenn dieses Problem gelöst ist, könnten DVDs mit Mehrkanal-Ton die CD ablösen. Wer Geld genug hat, um sich häufig CDs oder DVDs zu kaufen, hat wegen Vollzeit-Arbeit wenig Zeit und Lust auf zusätzliche Probleme, die sich aus der Technik ergeben. Er möchte aber gerne sein neues gekauftes CD/DVD-Album auf dem Weg zur Arbeit im Autoradio oder auf dem I-Pod in der Straßenbahn hören. Mit CDs geht das schnell und einfach; bei DVDs eben nicht. Der ganze Kopierschutz-Mumpitz bei DVDs, SACDs oder DVD-Audios verhindert ja nun de Facto gerade nicht, dass Kopien im Netz auftauchen oder Ident-Fälschungen hergestellt werden, da echte Produktpiraten sämtliche Kopierschütze knacken, oder einfach den analogen Umweg gehen. Es behindert aber den ehrlichen Konsumenten darin, sich seine gekauften Lieblingsalben unterwegs anzuhören. Was aus Konsumentensicht bloß nervig und ärgerlich ist, und den Spaß an der Musik verdirbt. Wer Vollzeit arbeitet und Geld genug hat, um sich Alben zu kaufen, hat wegen der Arbeit keine Zeit, sich irgendwelche MP3s im Netz als Raubkopien zu suchen. Es geht schneller und einfacher, sich beim Mediamarkt, Amazon oder JPC die Titel zu bestellen/kaufen. Wenn man dann aber mit - letztlich unwirksamen, aber lästigen - Kopierschutzmassnahmen á la HDMI o.ä. angenervt wird, verliert man die Lust am aktiven Konsum. Man hört statt gekaufter Alben eben einfach das, was im Autoradio so rumdudelt. Und kauft eben nichts mehr... Der ganze Hochauflösungs-Zirkus, der mit SACD oder ähnlichem veranstaltet wird, bringt dem Konsumenten keinen Zusatz-Nutzen: Mehr Bits Auflösung, höhere Abtastrate als bei CDs bringt keinen hörbaren Zugewinn. Im Gegenteil, wegen technischer Probleme verhindert er, dass die Musik dort gehört werden kann, wo es der Konsument möchte: I-Pod, Autoradio. Statt mehr Musikgenuss eben weniger, weil nicht überall hörbar. MfG |

||||

|

Das.Froeschle

Inventar |

#23

erstellt: 29. Dez 2011, 01:24

|

|||

Das liegt aber nicht an der besseren Auflösung oder Abtastrate, sondern am (sinnfreien) Kopierschutz. Dafür kann das Format ja nichts... |

||||

|

GraphBobby

Stammgast |

#24

erstellt: 29. Dez 2011, 01:37

|

|||

|

Dazu merke ich einmal an, dass 32 bit nicht "ein bisschen mehr" sind als 24 bit, sondern das 256-fache. Mit 24 bit hat man die Werte von -8.388.608 bis +8.388.607 zur Verfuegung, um die Amplitude am jeweiligen Messpunkt (192.000 Messpunkte pro Sekunde bei 192kHz) anzugeben, d.h. man hat ein paar Millionen Lautstaerkeabstufungen. Mit 32 bit waeren es die Werte von -2.147.483.648 bis +2.147.483.647 zur Verfuegung, also Lautstaerkeabstufungen im Milliardenbereich. Bei der CD mit 16 bit sind es die Werte von -32.768 bis +32767, und da ist es schon fragwuerdig, ob der Unterschied zu 24 bit eindeutig identifizierbar ist. Dass das mehr ist, als man jemals benoetigen wuerde, und auch mehr, als einen hoerbaren Unterschied zwischen 24 bit und 32 bit ausmachen wuerde, ist wohl offensichtlich. |

||||

|

Burkie

Inventar |

#25

erstellt: 29. Dez 2011, 01:43

|

|||

|

Nun, das eine ist mit dem anderen ja verbunden. Aus Konsumentensicht bringen alle neuen Formate bloß technische und praktische Probleme, die Inhalte abspielen zu können. Von der Erfordernis, neue Geräte kaufen und anschliessen zu müssen, mal ganz abgesehen. Letztendlich muss man sich auch einem Studium der verschiedenen Zertifizierungen (HDMI 1.4, DVI, etc.) und Anschluss-Techniken (digital per S/PDIF, analog, etc.) unterziehen, was einfach nur nervig ist, wenn man sich in seiner Freizeit mit Musik entspannen und unterhalten will. Anstatt sich neue, unnötige Probleme aufhalsen will. MfG |

||||

|

Burkie

Inventar |

#26

erstellt: 29. Dez 2011, 01:55

|

|||

hMMM, 32 Bit Auflösung bedeuten ca. 190 dB Dynamik/Rauschabstand. Die Schmerzgrenze des Gehörs liegt wohl bei ca. 130dB, bei dem unmittelbar Gehörschaden eintritt; Gehörschaden bei dauerhaftem Hören tritt bei ca. 90dB ein, was mit 16 Bit problemlos abdeckbar ist. Kein Mikrophon kann 190dB Dynamik bringen, praktische Musikaufnahmen haben max. ca. 80dB Rauschabstand. Damit ist man mit 16 Bit immer noch überdimensioniert. MfG |

||||

|

Accuphase_Lover

Inventar |

#27

erstellt: 29. Dez 2011, 01:58

|

|||

Na ja, 720p ist immerhin die 2,222... fache Auflösung von SD und damit durchaus relativ HD. Lediglich kein Full HD, was aber auch nur Definitionssache ist !  Im Gegensatz zur Steigerung von Quantisierungstiefe und Samplingfrequenz gegenüber den Red Book - Specs. im Audiobereich, ist der Auflösungsgewinn im Videobereich aber DEUTLICH sichtbar.  |

||||

|

audiophilanthrop

Inventar |

#28

erstellt: 30. Dez 2011, 20:10

|

|||

Eher machen der Weihnachtsmann und der Osterhase ein Joint-Venture auf. Gutes Videomaterial produziert sich auch nicht von selber.

Und das ist der Punkt. Wobei ich blindes Huhn dann schon so weit an den Schirm ran muß, daß ich nur noch einen Teil des Bildes sehe. Gut heruntergerechnetes (!) 360p tut's für mich normalerweise auch. Und so ähnlich ist das auch bei Tonformaten. Ich wette, wenn man hochwertiges hochauflösendes Material hat und das z.B. mit SoX (VHQ) auf 16/44 bringt und dann über hinreichend hochwertiges Equipment abspielt, wird kein Mensch den Unterschied zum Original hören. (So wie es die Theorie sagt.) Wie erwähnt, als Distributionsformat tut's das völlig. Für Aufnahmen ist je nach ADC-Qualität minimal 24/48 oder 24/88 anzusetzen, alles jenseits von 24/96 ist nur noch für Spezialanwendungen interessant. [Beitrag von audiophilanthrop am 30. Dez 2011, 20:14 bearbeitet] |

||||

|

Winlavay

Neuling |

#29

erstellt: 02. Nov 2012, 19:00

|

|||

|

16 bit 44,1 KHz ist nur der Tatsache geschuldet, dass damals computertechnisch nicht mehr ging. CD reicht eben nicht aus, sondern ist ein Schrott-Format genauso wie damals VHS Videokassetten. Im Bild-Bereich gibt es deswegen endlich HD und Blueray, was nicht 'ganz toll' ist, sondern endlich den Mist von damals übersteigt und eine vernünftige, an unsere Augen angepasste Leistung bringt wie sie sein sollte. Exakt so verhält es sich mit Audio. CD Qualität ist unzureichend für unsere Ohren. Ich erwarte, dass das DSD Format ultrahoch aufgelöst eine ähnliche Revolution in Ton wie damals Blueray für Bild bringt. Wer den Unterschied nicht oder nur marginal hört, hat eine Übertragungstechnik (Speaker/Amp) die unzureichend ist. |

||||

|

Jeck-G

Inventar |

#30

erstellt: 02. Nov 2012, 19:11

|

|||

|

Nach 5 Jahren mal was geschrieben und dann auch noch ein Trollpost... Und auch noch einen alten Thread aus dem Grab geholt.

Und jetzt bist DU dran mit vernünftigen Begründungen.  [Beitrag von Jeck-G am 02. Nov 2012, 19:15 bearbeitet] |

||||

|

drSeehas

Inventar |

#31

erstellt: 02. Nov 2012, 19:15

|

|||

Da bin ich ganz anderer Meinung! Ich besitze viele ganz hervorragend klingende CDs. Natürlich gibt es auch viele Schrott-CDs, aber das liegt am Mastering und nicht am CD-Format.

Das DSD-Format hat sich nicht durchgesetzt. Von Revolution kann also keine Rede sein. DSD war übrigens lange vor der BD da.

Meine Übertragungstechnik kannst du in meinem Profil nachlesen. Ich bin nicht der Meinung, dass meine Übertragungstechnik (Speaker: KEF iQ90 / Amp: Denon AVR-4310) unzureichend ist. [Beitrag von drSeehas am 02. Nov 2012, 19:20 bearbeitet] |

||||

|

pelmazo

Hat sich gelöscht |

#32

erstellt: 02. Nov 2012, 19:50

|

|||

Keine Ahnung, aber einfach mal was behaupten? Die Abtastrate der CD hat mit der Computertechnik nichts, aber auch gar nichts zu tun. Die Computertechnik und die CD haben sich erst später vermischt, als basierend auf der CD das CD-ROM Format definiert wurde. Die Abtastrate der CD wurde von der Notwendigkeit diktiert, daß man für das CD-Mastering ein Aufnahme- und Austauschmedium brauchte, und die einzige damals verfügbare technische Lösung (CD-R gab's noch nicht) basierte auf Video-Bandmaschinen, für die man schon vor der CD sogenannte PCM-Adapter gebaut hatte. Das war sogar eine Zeit lang für HiFi-Enthusiasten zu kaufen, z.B. Sony PCM-1 ab 1977 - diese wurden dann obsolet, als für HiFi-Zwecke der DAT-Rekorder auf dem Markt erschien. Für das CD-Mastering verwendete man insbesondere das U-matic Video-Kassettenformat, und die PCM-Adapter von Sony PCM-1600/1610/1630. Der PCM-Adapter setzte die digitalisierten Audiosignale auf ein Signal um, das ein Videorekorder aufzeichnen konnte. Dazu war nötig, daß die Bildfrequenz und die Abtastrate in einem bestimmten, festen Verhältnis zueinander standen, wobei sich als geeignetster Kompromiß bei 16 bit Wortlänge ein Wert von 44100 Hz ergab. (Genau genommen gilt 44100 Hz nur für NTSC Video. Bei PAL ergibt sich 44056 Hz, aber die geringe Abweichung hielt man für tolerabel). Hätte man eine beliebige Abtastrate verwendet (z.B. die ansonsten weit verbreitete Rate von 48 kHz), dann hätte man ein passendes Masteringsystem gleich auch noch entwickeln müssen, und das war den beteiligten Firmen zu teuer, zu riskant und zu zeitraubend. Solche Informationen hättest Du Dir mit ein bißchen Recherche auch besorgen können, bevor Du einen Uralt-Account aktivierst, bloß um dann Blödsinn zu verzapfen. Oder wolltest Du bewußt rumtrollen? |

||||

|

Burkie

Inventar |

#33

erstellt: 02. Nov 2012, 20:30

|

|||

|

Welche Abtastrate hat dann exakt die CD? Oder ist das je nach Region (PAL- oder NTSC-Land) unterschiedlich? Gibt es heute noch diese Unterschiede der Abtastraten? Grüße |

||||

|

pelmazo

Hat sich gelöscht |

#34

erstellt: 02. Nov 2012, 22:25

|

|||

44100 ist die Norm-Abtastrate, unabhängig von PAL oder NTSC. Ein Fehler von 0,1% ist aber erlaubt. 44056 wäre also gerade noch innerhalb der Toleranz. Wenn man eine CD mit 44056 kHz gemastert hat, und die wird dann normal abgespielt (mit 44100 Hz), dann wird man den Unterschied praktisch nicht bemerken. Eine Tonhöhenänderung von 0,1% fällt nicht auf, und die Laufzeit einer ganzen CD von etwa 70 Minuten wäre um weniger als 5 Sekunden kürzer als das Original. Das hat niemand für relevant gehalten. |

||||

|

Das.Froeschle

Inventar |

#35

erstellt: 03. Nov 2012, 10:34

|

|||

|

Wenn sich hier schon mal die geballte Kompetenz versammelt... Wenn ein D/A-Wandler 'nur' bis zu 48kHz/24 Bit kann, könnte man diesen per 'downsample' auch mit z.B. 96 oder gar 192 kHz versorgen? D.h. eine 'trickreiche' Logikschaltung davorhängen und damit z.B. nur jeden 2. ( bzw. jeden 4.) Samplewert durchkommen lassen? Würde sowas funktionieren? Oder gibt es das schon irgendwo als Black-Box? Wo ist/wäre mein Denkfehler?  |

||||

|

Burkie

Inventar |

#36

erstellt: 03. Nov 2012, 10:48

|

|||

|

Hallo, das heißt wohl, CDs aus Deutschland (PAL) wurden mit 44,056kHz auf U-Matic pre-gemastert und mit 44,1kHz abgespielt, also ein Tick zu schnell. CDs aus NTSC-Land werden aber (wenn das Pre-Master dort gemacht wird), mit 44,1kHz digitatlisiert und abgespielt, also in der richtigen Geschwindigkeit. Nicht, das man das hören könnte. Aber damit könnte man u.U. die Quellen von Remasters etc. lokalisieren. Zu Beginn der CD-Ära gab es ja nur Polygram in Hannover, und wahrscheinlich wurde dort auch fast immer das Pre-Master gemacht. Also mit 44,056kHz. Wird irgendwann später, also man nicht mehr U-Matic verwendete, ein Remaster herausgebracht, sollte das dann doch mit der "richtigen" Rate von 44,1kHz digitalisiert worden sein. Ausser natürlich, man nimmt als Remaster-Quelle die alte CD-Version. Grüße |

||||

|

drSeehas

Inventar |

#37

erstellt: 03. Nov 2012, 11:42

|

|||

Interessanter Gedanke, nur: Wie willst du feststellen, ob man eine CD mit 44100 Hz oder mit 44056 Hz gemastert hat, ohne von jeder Version eine CD zu besitzen? Außerdem wurde am Anfang nicht nur in Hannover, sondern auch in Japan bei Sony gemastert. Soweit ich weiß, wurde zumindest dort 44100 Hz verwendet. [Beitrag von drSeehas am 03. Nov 2012, 16:51 bearbeitet] |

||||

|

lumi1

Hat sich gelöscht |

#38

erstellt: 03. Nov 2012, 11:47

|

|||

|

Für die durchschnittliche Qualität heutiger (Mainstream)AudioAufnahmen würde wieder die Wachswalze, max. aber die Compact Cassette genügen. Und für anspruchsvollste Klassik, und davon besten Aufnahmen, genügt die CD. MfG. |

||||

|

Sirvolkmar

Hat sich gelöscht |

#39

erstellt: 03. Nov 2012, 11:53

|

|||

Ja,wenn das Wörtchen WENN nicht wäre. Wenn sie die CD richtig im Tonstudio produzieren würden und ihr DR nicht hoch powern wäre die CD tatsächlich gut. Leider ist das nicht so. Also immer aufpassen ob die Cd was taucht oder doch die Lp nehmen bzw.sogar die SACD. |

||||

|

drSeehas

Inventar |

#40

erstellt: 03. Nov 2012, 11:58

|

|||

Dieses WENN gilt aber genauso für die LP und die SACD oder DVD-Audio oder BD, schlicht für jedes Format. Eine LP oder SACD ist nicht per se besser, man muss also auch da aufpassen. Allerdings dürfte die Wahrscheinlichkeit bei den teureren Formaten höher sein. |

||||

|

Sirvolkmar

Hat sich gelöscht |

#41

erstellt: 03. Nov 2012, 12:08

|

|||

Dein Blog gefällt mir sehr  . .Sehr gut geschrieben werde mal näher das alles lesen. Ich bin ja auch ein Freund von guter Musik wiedergabe und auf der suche was man besser machen kann. |

||||

|

Burkie

Inventar |

#42

erstellt: 03. Nov 2012, 13:51

|

|||

Gar nicht. Man braucht als Vergleich schon die Erstausgabe der CD. Die Master-Samplerate kann man so auch nicht bestimmen, nur, ob eine CD gerinfügig schneller läuft als die andere. Dazu braucht man wohl einen Audio-Editor.

Das mag schon stimmen. Wenn es sich ursprünglich um digitale Produktionen handelt, bei denen für's Pre-Master die Samplerate von 48kHz auf nominel 44,1kHz gewandelt werden musste, wurde das zu Anfangszeiten wohl hauptsächlich über eine DA-AD-Wandlung gemacht. Vorausgesetzt, das 48kHz-Band läuft überall auf der Welt hinreichen gleich schnell, so sollte man die unterschiedlichen Pre-Master-Raten im Audio-Editor bemerken können. Wurde von analogen Tonbändern gemastert, ist anzunehmen, das verschiedene Kopien der Bänder in verschiedenen Presswerken an gegensätzlichen Enden der Welt "von Natur aus" unterschiedlich schnell laufen (nur begrenzte Einhaltung der Sollgeschwindigkeit analoger Tonbänder). Erstausgaben von CDs, die etwa von Kopien von Schallplattenmastern pre-gemastert wurden, sollten sich in ihre Geschwindigkeit geringfügig unterscheiden von Remastern, die angeblich von originalen Masterbändern (der ersten Generation) pre-gemastert wurden. Grüße |

||||

|

pelmazo

Hat sich gelöscht |

#43

erstellt: 03. Nov 2012, 15:36

|

|||

Das nennt man "downsampling", und man läßt nicht bloß Samples weg, sondern macht zuvor noch eine Tiefpaßfilterung, sonst gibt's Aliasing. Die meisten aktuellen D/A-Wandler arbeiten aber nach dem Sigma-Delta-Prinzip, was bedeutet daß sie intern das Gegenteil tun, nämlich Upsampling auf das 64-fache oder 128-fache der Abtastfrequenz. Die reagieren auf 96 kHz oder 192 kHz einfach durch einen entsprechend kleineren Upsampling-Faktor. |

||||

|

pelmazo

Hat sich gelöscht |

#44

erstellt: 03. Nov 2012, 15:40

|

|||

Nein, denn niemand zwingt einen deutschen Toningenieur, seine U-matic Bandmaschine im PAL-Modus zu betreiben. Er hat dazu keinen zwingenden Grund, schließlich soll das Ergebnis ja nicht auf einem PAL-Fernseher wiedergegeben werden. Die Wahl der Abtastrate hängt damit nicht vom Standort des Masteringstudios ab.

Manchmal kann man anhand von Resten der Netzfrequenz (Brumm) im Signal erkennen, wo es aufgenommen oder bearbeitet wurde. Das ist aber ein anderer Punkt... [Beitrag von pelmazo am 03. Nov 2012, 15:41 bearbeitet] |

||||

|

Das.Froeschle

Inventar |

#45

erstellt: 03. Nov 2012, 16:20

|

|||

Der Sinn des Tiefpaß ist für mich nachvollziehbar, denn 'dank' 96 kHz könnte ich ja den (unsinnigen) Höhenbereich bis weit über 40kHz für Fledermäuse mit aufzeichnen. Das schaffe ich mit 48 kHz nicht (mehr) Nur... wie kann ich mir diesen Tiefpaß programmtechnisch vorstellen? Rechnet dieser die Anteile über 2o kHz aus dem 96 kHz Signal raus? |

||||

|

cr

Inventar |

#46

erstellt: 03. Nov 2012, 16:22

|

|||

|

Im Prinzip ähnlich wie ein steiler analoger Filter, nur dass die Filterung eben auf Zahlenebene erfolgt (durch Rechnen). |

||||

|

pinoccio

Hat sich gelöscht |

#47

erstellt: 03. Nov 2012, 16:41

|

|||

Ich würde ja behaupten, es ist genau umgekehrt. Zumindest wenn man davon ausgeht, wenn du mit Mainstream-Audio-Aufnahmen jene Produktionen meinst, die mit allerhand "Gemeinheiten" im Bezug auf Klang- und Dynamikmanipulation daherkommen. Wie man es auch dreht, es ist danach deutlich mehr Klang drauf, als vorher vlt. aufgenommen wurde. Gemein daran ist (mE), dass für "mehr Klang" weniger als 16bit/44,1khz erforderlich ist. Sogar niedrigcodierte MP3s können diesen "Mehrklang" transportieren. Bei CC und Wachswalze mag ich das bezweifeln... die Grenzen sind mE irgendwo im Audio-Mastering o. Formatmastering betreffender Tonmedien zu suchen. Ums noch verdrehter zu formulieren: "CD kann so grauenhaft klingen, weil sie es kann und weil das auf anderen Medien gar nicht möglich ist". Und man darf natürlich nie die Frage stellen, was Klang resp. objektiv guter Klang sein sollte.... [Beitrag von pinoccio am 03. Nov 2012, 16:47 bearbeitet] |

||||

|

AndreasHelke

Stammgast |

#48

erstellt: 03. Nov 2012, 20:00

|

|||

|

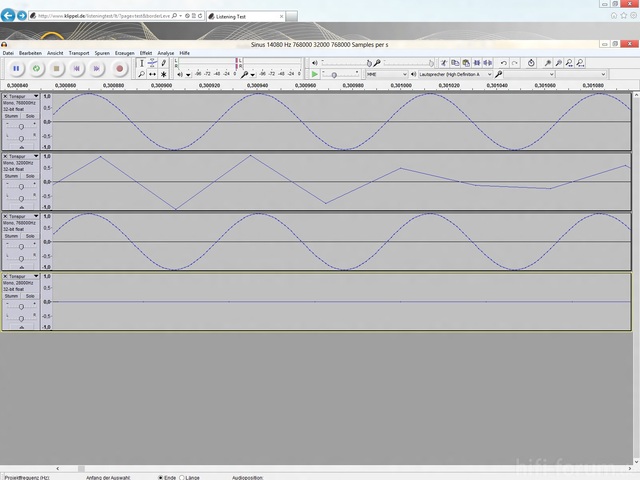

Jeder moderne DA Konverter macht mehrfaches Oversampling bevor er das Analogsignal erzeugt. Das kostet heute nichts mehr und macht vermutlich die Konstruktion des Analogteils des ICs etwas einfacher. Solange man mit mindestens 2 Samples pro Sinusschwingung des Analogsignals arbeitet hat man genügend Informationen, um das Analogsignal praktisch perfekt zu rekonstruiren oder mit Up- oder Downsampling die verwendete Samplingfrequenz zu verändern. Der Computer macht das um Gleichzeitig 44.1 und 48 kHz Digtialdaten als hörbare töne auszugeben. Ich habe mit Audacity einen 14080 Hz Sinuston bei 384kHz Samplerate erzeugt. Den dann auf 44.1 kHz umgerechnet und dieses Signal dann wieder auf 384 kHz hochgerechnet. Dieses Signal sieht genau so aus wie das Originalsignal.  Wenn man nur 28 kHz als Samplefrequenz benutzt kann man eine 14080 Hz Schwingung nicht aufzeichnen. Deshalb entfernt der AD Konverter dieses Signal vollständig. Update: Ich habe beim Hochladen die falsche Bilddatei erwischt. Was hier tatsächlich zu sehen ist, ist ein 14080 Hz Ton der mit einer Samplerate von 768 kHz aufgezeichnet ist dann in 32 kHz konvertiert wird und anschließend wieder zu 768 kHz umgerechnet wird. [Beitrag von AndreasHelke am 04. Nov 2012, 02:48 bearbeitet] |

||||

|

pelmazo

Hat sich gelöscht |

#49

erstellt: 03. Nov 2012, 20:10

|

|||

Nur ein idealer A/D-Wandler entfernt es vollständig. Reale Konverter sind nur unvollkommene Annäherungen an dieses Ideal. Sie unterdrücken zu hohe Frequenzen im Eingangssignal um einen Faktor, der auf Englisch "Stopband-Attenuation" heißt. Dieser Wert kann sich von Wandler zu Wandler beträchtlich unterscheiden. |

||||

|

AndreasHelke

Stammgast |

#50

erstellt: 03. Nov 2012, 20:15

|

|||

Als die CD eingeführt wurde waren Computer mit CD Daten schon hoffnungslos überfordert. Das Format wurde so eingerichtet weil man da etwas Reserve hat zu dem was das Ohr und Gehirn beim Musikhören erkennen kann. Die CD Qualität entspricht also dem 4K Format bei Videoproduktionen. HD Daten für Endkunden sind eine reine Marketingmasche ohne besseren Klang zu bieten als die Selbe Produktion hätte, wenn sie ins 44.1kHz 16bit umgerechnet und auf CD gepresst würde. Während der Aufnahme und Produktion machen 24 bit Sinn weil man da 2 - 3 dB weniger Aussteuern kann und damit die Gefahr des Übersteuerns reduziert. Von den 24 bit kann allerdings real existierende Audioelektroik nur 18-21 bit ausnutzen weil man das Rauschen nicht auf 0 reduzieren kann. [Beitrag von AndreasHelke am 03. Nov 2012, 22:58 bearbeitet] |

||||

|

Jeck-G

Inventar |

#51

erstellt: 03. Nov 2012, 21:11

|

|||

|

||||

| ||||

|

|

||||

| Das könnte Dich auch interessieren: |

|

Wandlerunterschied Burr-Brown 24-Bit/96 kHz vs. Burr-Brown 192 khz/24-bit Milamedia am 22.02.2009 – Letzte Antwort am 30.03.2009 – 41 Beiträge |

|

NAIM UnitiServe 192 kHz abspielen ? onkel-thor am 04.01.2022 – Letzte Antwort am 14.01.2022 – 3 Beiträge |

|

Electrocompaniet PD1 neuer DAC 192 khz/24bit Puredirect am 09.01.2011 – Letzte Antwort am 12.01.2011 – 8 Beiträge |

|

Sampling Conversion 44,1 auf 48 kHz Qualitätsverlust? dharkkum am 19.09.2011 – Letzte Antwort am 18.10.2011 – 9 Beiträge |

|

DVD-Player als CDP ersatz??? Class_B am 12.05.2006 – Letzte Antwort am 30.05.2006 – 48 Beiträge |

|

Update EMC-1 von Electrocompaniet Joerg000 am 13.06.2006 – Letzte Antwort am 01.08.2008 – 6 Beiträge |

|

Technics DAT SV-DA10, analog aufnehmen mit 44,1 kHz ? Masselcat am 23.07.2010 – Letzte Antwort am 30.07.2010 – 6 Beiträge |

|

Marantz SA15S2 pruedi0 am 26.01.2015 – Letzte Antwort am 26.01.2015 – 2 Beiträge |

|

Ab wann machen SACDs Sinn? d33k4y am 24.10.2011 – Letzte Antwort am 24.11.2011 – 65 Beiträge |

|

MP3 Upsampling 24/192 sni_hh am 16.06.2010 – Letzte Antwort am 11.07.2010 – 22 Beiträge |

Foren Archiv

Anzeige

Produkte in diesem Thread

Aktuelle Aktion

Top 10 Threads in CD-/SACD-Player & andere digitale Quellen der letzten 7 Tage

- Wie viel Sinn machen 32 Bit, 192 kHz und 384 kHz?

- Musik CD abspielen mit BluRay Player

- Laufwerksgeräusche von CD-Playern

- Klangverlust durch XLR auf Cinch?

- Bluesound Node + ext Netzteil Teddy Pardo

- Was tun , wenn CD nicht erkannt wird?

- CD-Wiedergabe - knistern etc

- Panasonic SC-PM02 erkennt USB-Stick nicht

- Wann wird Jitter hörbar? Und kann man Digitalgeräte mit hörbarem Jitter tatsächlich kaufen?

- Marantz SA 11 S3 oder Ruby KI

Top 10 Threads in CD-/SACD-Player & andere digitale Quellen der letzten 50 Tage

- Wie viel Sinn machen 32 Bit, 192 kHz und 384 kHz?

- Musik CD abspielen mit BluRay Player

- Laufwerksgeräusche von CD-Playern

- Klangverlust durch XLR auf Cinch?

- Bluesound Node + ext Netzteil Teddy Pardo

- Was tun , wenn CD nicht erkannt wird?

- CD-Wiedergabe - knistern etc

- Panasonic SC-PM02 erkennt USB-Stick nicht

- Wann wird Jitter hörbar? Und kann man Digitalgeräte mit hörbarem Jitter tatsächlich kaufen?

- Marantz SA 11 S3 oder Ruby KI

Top 10 Suchanfragen

Forumsstatistik

- Registrierte Mitglieder931.197 ( Heute: 7 )

- Neuestes MitgliedVegazoneSpel

- Gesamtzahl an Themen1.564.914

- Gesamtzahl an Beiträgen21.871.708